29/01/2025

En el vasto universo de la modelización, donde se busca comprender y simular realidades complejas, los modelos matemáticos emergen como herramientas indispensables. Particularmente en campos como la farmacoeconomía, estos esquemas teóricos nos permiten realizar simulaciones detalladas de procesos sanitarios, comparando la eficiencia de distintas alternativas terapéuticas o preventivas. Aunque no poseen la misma validez que los ensayos clínicos, su menor costo y rápida ejecución los convierten en aliados estratégicos en las fases tempranas del desarrollo de fármacos y en la negociación con autoridades sanitarias.

Dentro de esta disciplina, se distinguen dos grandes tipos de modelos: los determinísticos y los estocásticos. Los modelos determinísticos operan con cantidades fijas, asumiendo una certidumbre total en los datos; por ejemplo, si una tasa de mortalidad es del 10%, se asume que exactamente el 10% de la población morirá. Por otro lado, los modelos estocásticos abrazan la incertidumbre, utilizando la aleatorización para simular las probabilidades de distribución de eventos, reflejando así la complejidad y el azar inherentes a la realidad. Entre estos últimos, el modelo estocástico más empleado y reconocido es el denominado modelo de Markov, cuyo origen se remonta al trabajo del matemático ruso Andrei Andreyevich Markov, una figura clave en la teoría de los procesos estocásticos.

- ¿Qué son los Modelos de Markov y Cuándo Utilizarlos?

- Ventajas y Desventajas de los Modelos de Markov

- Tipos de Modelos de Markov: Cadenas y Procesos

- Pasos Esenciales para la Construcción de un Modelo de Markov

- Ejemplo Teórico: Cadenas de Markov en un Modelo de Vacunación

- Ejemplo Práctico: Procesos de Markov en Terapia Hormonal Sustitutiva (THS)

- Casos Especiales en las Cadenas de Markov

- Preguntas Frecuentes sobre los Modelos de Markov

¿Qué son los Modelos de Markov y Cuándo Utilizarlos?

Un modelo de Markov, aplicado a cualquier campo que implique la evolución de un sistema a lo largo del tiempo, puede entenderse como una representación estocástica de un proceso. En el ámbito sanitario, por ejemplo, asume que un paciente se encuentra siempre en uno de un número finito de estados de Markov. Estos estados deben ser exhaustivos (cubrir todas las posibilidades) y mutuamente excluyentes (un individuo no puede estar en dos estados a la vez). Los estados pueden ser de dos tipos:

- Absorbentes: Son aquellos de los que, una vez se entra, no se puede salir. El ejemplo más claro es el estado de «muerte».

- No absorbentes: Cualquier estado desde el que se puede transitar a otro diferente.

Los eventos se modelizan como pasos o transiciones de unos estados a otros, que ocurren en períodos uniformes de tiempo, conocidos como ciclos de Markov. La probabilidad de transición de un estado a otro depende únicamente del estado actual del individuo, no de su historial previo. Esta característica es fundamental y se conoce como la suposición markoviana, implicando que el modelo carece de «memoria». Esto significa que, si un paciente pasa de «sano» a «enfermo», su pronóstico en el estado «enfermo» es el mismo que el de otro paciente que ya estaba «enfermo» y permanece en ese estado, independientemente de cómo llegó allí.

Los modelos de Markov son especialmente útiles cuando se trata de eventos repetitivos, irreversibles y de larga duración, como muchas enfermedades crónicas. Las condiciones generales para su aplicación incluyen:

- Solo se permiten transiciones previamente establecidas entre los estados.

- La duración de los ciclos de Markov debe ser constante a lo largo de toda la simulación.

- Cada paciente solo puede realizar una transición por ciclo.

- Todos los pacientes están sujetos a las mismas probabilidades de transición en un momento dado.

Visualmente, estos modelos pueden representarse de diversas formas, como árboles de decisión, diagramas en cascada o diagramas de influencias, facilitando la comprensión de las interacciones entre los estados.

Ventajas y Desventajas de los Modelos de Markov

La principal ventaja de los modelos de Markov radica en su capacidad para modelizar eventos complejos que podrían ser excesivamente simplificados por los modelos determinísticos. Son particularmente eficaces para simular la evolución de enfermedades crónicas a lo largo del tiempo, ofreciendo una representación más realista de lo que ocurre en el proceso de la enfermedad. Su naturaleza estocástica permite incorporar la incertidumbre y la variabilidad inherente a los fenómenos biológicos y sociales.

Sin embargo, no están exentos de inconvenientes. En ocasiones, la inviabilidad de estos modelos surge de la insuficiencia de datos disponibles, lo que dificulta establecer la totalidad de las probabilidades de transición entre todos los estados de salud posibles, especialmente en modelos muy complejos. Además, como se mencionó, la suposición markoviana (la falta de memoria del modelo) puede no ajustarse estrictamente a la realidad de muchas enfermedades, donde el historial clínico previo del paciente sí influye en su pronóstico futuro. Esto puede representar una limitación importante en la precisión del modelo para ciertas condiciones.

Tipos de Modelos de Markov: Cadenas y Procesos

Existen dos tipos principales de modelos de Markov, diferenciados por la constancia de sus probabilidades de transición:

- Cadenas de Markov: En este tipo, las probabilidades de transición entre los estados permanecen constantes a lo largo de toda la simulación. Son adecuadas para problemas con un horizonte temporal relativamente corto, donde se puede asumir que las probabilidades no varían significativamente.

- Procesos de Markov: Aquí, las probabilidades de transición pueden variar con el tiempo, generalmente ajustándose a factores como la edad. Son preferibles para enfermedades crónicas de larga duración, donde las tasas de morbilidad y mortalidad suelen aumentar con la edad. El desafío en estos casos radica en la disponibilidad de datos fiables por intervalos de edad para calcular estas probabilidades variables.

Pasos Esenciales para la Construcción de un Modelo de Markov

La creación de un modelo de Markov sigue una serie de pasos estructurados para asegurar su coherencia y utilidad:

- Definir los estados de salud: Identificar todos los estados posibles en los que un individuo puede encontrarse (p. ej., sano, enfermo, muerto).

- Establecer las transiciones permitidas: Determinar qué movimientos son posibles entre los estados.

- Definir la amplitud de los ciclos: Fijar la duración de cada período de tiempo en el que ocurren las transiciones (p. ej., meses, años).

- Fijar las probabilidades de transición: Cuantificar la probabilidad de pasar de un estado a otro en cada ciclo.

- Determinar la utilidad y los costes de cada estado: Asignar valores a cada estado en términos de resultados de salud (utilidad, como años de vida ajustados por calidad - AVAC) y recursos consumidos (costes).

- Resolver la simulación: Ejecutar el modelo para obtener los resultados deseados.

La resolución de un modelo de Markov puede llevarse a cabo mediante diferentes métodos. La simulación de una cohorte hipotética permite seguir a un grupo de individuos a través de los estados. La simulación de Monte Carlo es más detallada, simulando el seguimiento individual de un gran número de pacientes (miles de veces) para obtener un valor medio. Finalmente, las matrices fundamentales son un método analítico que solo se puede usar para cadenas de Markov debido a la necesidad de probabilidades de transición constantes.

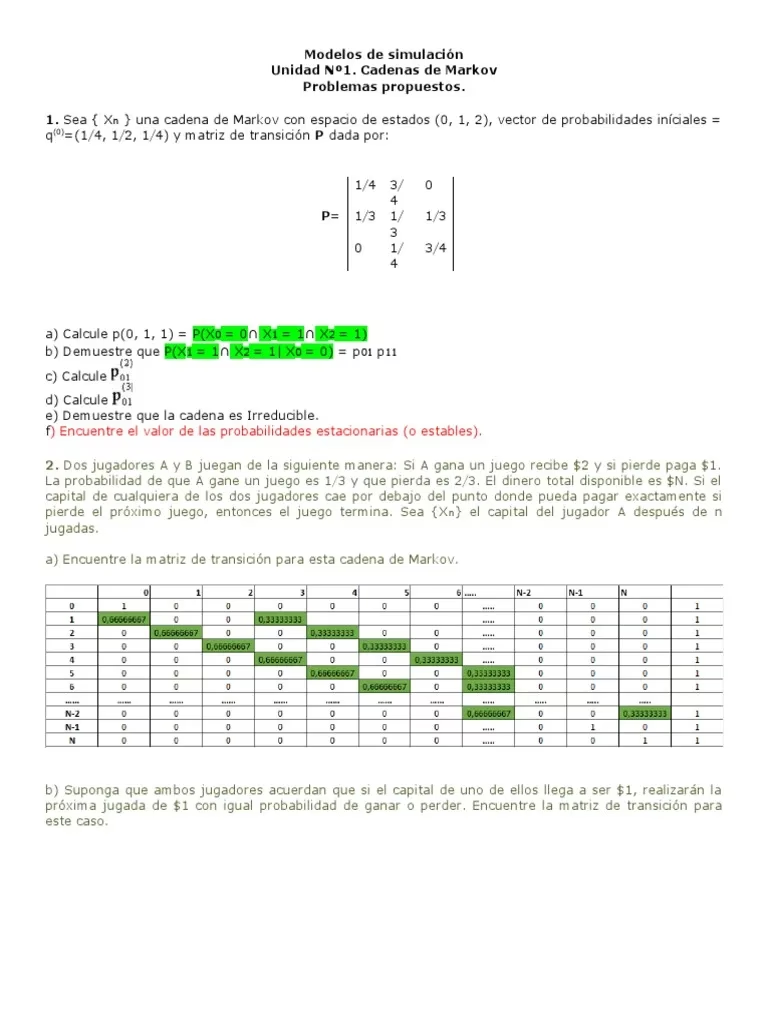

Ejemplo Teórico: Cadenas de Markov en un Modelo de Vacunación

Para ilustrar una cadena de Markov, consideremos un ejemplo simplificado: la comparación de la eficiencia entre administrar o no una vacuna que previene una enfermedad potencialmente mortal. Los estados posibles son 'salud', 'enfermedad' y 'muerte'.

Todos los individuos de una cohorte hipotética de 1.000 personas comienzan en el estado de 'salud'. Las transiciones permitidas desde este estado inicial son permanecer sano, enfermar o morir. Un paciente enfermo podría seguir enfermo o morir, mientras que el estado de 'muerte' es absorbente; una vez alcanzado, no hay salida. Se establece un ciclo de Markov anual, y la simulación se extiende por cinco ciclos (cinco años).

Las probabilidades de transición permanecen constantes durante los cinco años y se muestran en la siguiente tabla para cohortes vacunadas y no vacunadas:

| Desde: | Hasta Salud | Enfermedad | Muerte |

|---|---|---|---|

| Con vacunación | |||

| Salud | 0,6 | 0,2 | 0,2 |

| Enfermedad | 0 | 0,6 | 0,4 |

| Muerte | 0 | 0 | 1 |

| Sin vacunación | |||

| Salud | 0,4 | 0,3 | 0,3 |

| Enfermedad | 0 | 0,6 | 0,4 |

| Muerte | 0 | 0 | 1 |

La tabla muestra que los individuos vacunados tienen una mayor probabilidad de permanecer sanos y, por ende, una menor probabilidad de enfermar o morir en comparación con los no vacunados. La evolución de una cohorte de 1.000 individuos a lo largo de cinco años, aplicando estas probabilidades, se resume a continuación:

| Ciclo (año) | Estado de salud (Vacunados) | Total | Estado de salud (No vacunados) | Total | ||||

|---|---|---|---|---|---|---|---|---|

| Salud | Enfermedad | Muerte | Salud | Enfermedad | Muerte | |||

| 0 | 1.000 | 0 | 0 | 1.000 | 1.000 | 0 | 0 | 1.000 |

| 1 | 600 | 200 | 200 | 1.000 | 400 | 300 | 300 | 1.000 |

| 2 | 360 | 240 | 400 | 1.000 | 160 | 300 | 540 | 1.000 |

| 3 | 216 | 216 | 568 | 1.000 | 64 | 228 | 708 | 1.000 |

| 4 | 130 | 173 | 698 | 1.000 | 26 | 156 | 818 | 1.000 |

| 5 | 78 | 130 | 793 | 1.000 | 10 | 101 | 888 | 1.000 |

Al cabo de cinco años, la cohorte de vacunados tendría 68 individuos sanos más y se habrían evitado 95 muertes en comparación con la cohorte de no vacunados.

Análisis Farmacoeconómico del Ejemplo de Cadena de Markov

Para evaluar la eficiencia, se asignan costes y utilidades (AVAC) a cada estado de salud:

- Salud: 1.000 UM (Unidades Monetarias) y 1 AVAC.

- Enfermedad: 100.000 UM y 0,7 AVAC.

- Muerte: 500 UM y 0 AVAC.

El análisis coste-utilidad, que implica multiplicar los costes y utilidades de cada rama del árbol de decisiones por sus probabilidades de transición, arroja los siguientes resultados:

| Estrategia | Costes (UM) | Utilidades (AVAC) | Coste/utilidades (UM/AVAC) |

|---|---|---|---|

| Vacunación | 624.625 | 2,374 | 263.156 |

| No vacunación | 624.208 | 1,540 | 405.216 |

| Diferencia | 417 | 0,834 | -142.060 |

| A. coste-utilidad incremental | La estrategia de vacuna domina a la estrategia de no vacunar | ||

En este caso, la estrategia de vacunación resulta ser más efectiva (con una diferencia de 0,834 AVAC a su favor) y solo ligeramente más costosa, lo que en términos farmacoeconómicos significa que la vacunación domina a la estrategia de no vacunar, siendo la opción preferible.

Ejemplo Práctico: Procesos de Markov en Terapia Hormonal Sustitutiva (THS)

Los procesos de Markov, donde las probabilidades de transición varían con el tiempo, son ideales para modelar condiciones crónicas con evolución dependiente de la edad. Un ejemplo claro es la evaluación farmacoeconómica de la terapia hormonal sustitutiva (THS) en mujeres postmenopáusicas.

La historia natural de las mujeres menopáusicas, con la aparición aleatoria de complicaciones patológicas como fracturas de cadera (FC), cardiopatía isquémica (CI), accidentes cerebrovasculares (ACV) o cáncer de mama (CM) a lo largo de períodos prolongados, se presta perfectamente a la modelización mediante un proceso de Markov. Los estados de salud considerados incluyen las complicaciones, sus secuelas (secuelas 1, 2, 3), la recuperación a un estado de buena salud (salud 2), el estado de 'salud' inicial (ausencia de complicaciones) y, por supuesto, la muerte. Los ciclos de Markov se establecen anualmente.

Las probabilidades de transición se determinan por intervalos de edad, basándose en los riesgos relativos de padecer las complicaciones. Asumiendo una cohorte de mujeres de 50 años al inicio, el tratamiento con THS se evalúa durante quince años, con beneficios prolongados por un período adicional igual al del tratamiento.

Las suposiciones estándar sobre el riesgo de complicaciones después del tratamiento con THS se detallan a continuación, expresadas como riesgos relativos (RR) para diferentes grupos de edad:

| Edad en años de las mujeres de la cohorte | 50-54 | 55-59 | 60-64 | 65-69 | 70-74 | 75-79 | 80-84 | 85-89 | 90-94 | 95-99 |

|---|---|---|---|---|---|---|---|---|---|---|

| Fractura de cadera | 0,80 | 0,40 | 0,40 | 0,40 | 0,40 | 0,80 | 1,00 | 1,00 | 1,00 | 1,00 |

| Cardiopatía isquémica | 1,00 | 0,88 | 0,75 | 0,8 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

| Enfermedad cerebrovascular | 1,00 | 0,94 | 0,88 | 0,88 | 0,94 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

| Cáncer de mama | 1,00 | 1,00 | 1,30 | 1,30 | 1,30 | 1,00 | 1,00 | 1,00 | 1,00 | 1,00 |

Las probabilidades de transición anuales desde el estado de 'salud' con o sin THS, ajustadas por edad, son esenciales para este tipo de modelo y se ilustran con la siguiente tabla parcial (dado su extensión, se muestran solo algunas columnas clave):

| Edad | Salud | FC | CI | ACV | CM | Muerte |

|---|---|---|---|---|---|---|

| Sin THS | ||||||

| 50-54 | 0,99485 | 0,00008 | 0,00091 | 0,00059 | 0,00235 | 0,00122 |

| 60-64 | 0,98900 | 0,00046 | 0,00286 | 0,00181 | 0,00275 | 0,00312 |

| 70-74 | 0,97441 | 0,00298 | 0,00546 | 0,00445 | 0,00259 | 0,01011 |

| 80-84 | 0,91816 | 0,01491 | 0,00915 | 0,01464 | 0,00183 | 0,04131 |

| 90-94 | 0,87869 | 0,02496 | 0,00915 | 0,01464 | 0,00183 | 0,07073 |

| Con THS | ||||||

| 50-54 | 0,99482 | 0,00006 | 0,00091 | 0,00059 | 0,00235 | 0,00127 |

| 60-64 | 0,98931 | 0,00018 | 0,00215 | 0,00159 | 0,00358 | 0,00319 |

| 70-74 | 0,97683 | 0,00119 | 0,00480 | 0,00418 | 0,00337 | 0,00963 |

| 80-84 | 0,92708 | 0,01491 | 0,00733 | 0,01173 | 0,00183 | 0,03712 |

| 90-94 | 0,88811 | 0,02496 | 0,00733 | 0,01173 | 0,00183 | 0,06604 |

La resolución de estos procesos, debido a la complejidad de las probabilidades de transición variables, se realiza comúnmente con la ayuda de programas estadísticos y software especializado.

Casos Especiales en las Cadenas de Markov

Dentro de las cadenas de Markov, existen casos especiales con características únicas y aplicaciones diversas. Uno de los más relevantes es el estado absorbente. Un estado absorbente es aquel del que no se puede salir una vez se ha entrado; la probabilidad de permanecer en él es del 100%. Constituye una clase final de un único estado. Por ejemplo, en una cadena de Markov que modela la vida, el estado de 'muerte' es un claro ejemplo de estado absorbente, ya que no existe la posibilidad de volver a un estado anterior una vez alcanzado.

Preguntas Frecuentes sobre los Modelos de Markov

- ¿Qué es la cadena de Markov y para qué sirve?

- Una cadena de Markov es un modelo estocástico que describe una secuencia de eventos en la que la probabilidad de cada evento futuro depende únicamente del estado actual del sistema. Sirve para simular y analizar la evolución de sistemas complejos a lo largo del tiempo, especialmente aquellos con eventos repetitivos y duraderos, como la progresión de enfermedades, el comportamiento de mercados o la fiabilidad de componentes mecánicos.

- ¿Quién creó la cadena de Markov?

- Las cadenas de Markov fueron creadas por el matemático ruso Andrei Andreyevich Markov (1856-1922). Markov, profesor en la Universidad de San Petersburgo, es reconocido por sus estudios en la teoría de la probabilidad que sentaron las bases para la teoría de los procesos estocásticos.

- ¿Qué software se utiliza para resolver cadenas de Markov?

- La resolución de cadenas y procesos de Markov, especialmente en modelos complejos con probabilidades de transición variables, a menudo requiere el uso de software estadístico y de simulación. Programas como R, Python (con librerías como SciPy o NumPy), MATLAB, o software especializado en modelización de decisiones como TreeAge Pro, son comúnmente utilizados para realizar los cálculos y simulaciones necesarios.

- ¿Cuál es la diferencia entre una cadena de Markov y un proceso de Markov?

- La principal diferencia radica en las probabilidades de transición. En una cadena de Markov, estas probabilidades permanecen constantes a lo largo de toda la simulación. En un proceso de Markov, las probabilidades de transición pueden variar con el tiempo, lo que los hace más adecuados para modelar fenómenos de larga duración donde la probabilidad de eventos cambia, por ejemplo, con la edad.

- ¿Qué significa la "suposición markoviana"?

- La "suposición markoviana" implica que el modelo carece de "memoria". Es decir, la probabilidad de pasar a un estado futuro depende únicamente del estado actual del sistema, y no de cómo se llegó a ese estado. Todos los individuos en un mismo estado tienen el mismo pronóstico futuro, independientemente de su historial previo.

Si quieres conocer otros artículos parecidos a Modelos de Markov: Una Guía Completa para la Modelización Estocástica puedes visitar la categoría Automóviles.